Algorithmes de reconnaissance faciale, cas d’utilisation et controverse

Introduction

Les technologies de détection et de reconnaissance des visages existent, sont appliquées et font l’objet de recherches depuis des décennies. Elle est considérée comme un outil biométrique, comme la reconnaissance des empreintes digitales ou de l’iris, qui repose sur la détection de motifs et d’aspects spécifiques de la physiologie d’un visage pour reconnaître ou identifier la personne. Grâce aux progrès de la vision par ordinateur dans des domaines tels que le Deep Learning, aux améliorations du matériel de traitement de l’image et à la possibilité d’obtenir de grandes quantités de données et d’informations, cette technologie a atteint de nouveaux sommets, réalisant des améliorations en termes d’efficacité, de vitesse de traitement et de précision. Aujourd’hui, la reconnaissance faciale est utilisée pour tout, du déverrouillage d’un téléphone portable à la détection de criminels tentant de pénétrer dans un aéroport pour fuir le pays. Mais cette technologie est-elle légale ? Pourquoi y a-t-il tant de personnes pour et contre ? Comment fonctionne-t-elle et pourquoi de nombreuses organisations et entreprises l’introduisent-elles comme outil de vérification? Dans cet article, nous allons examiner la technologie qui sous-tend la détection et la reconnaissance des visages, les cas d’utilisation et ce que l’avenir nous réserve.

Histoire de la reconnaissance faciale

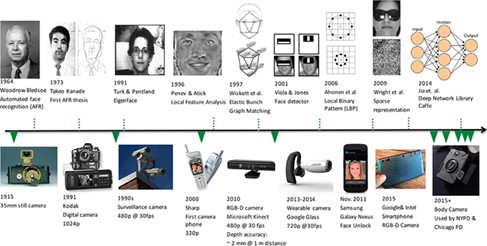

Les premiers systèmes de reconnaissance faciale étaient basés sur l’analyse de points d’intérêt, généralement appelés points de repère, où des informations telles que les distances entre eux pouvaient être extraites et converties en une opération mathématique représentant la signature faciale du sujet. Au fil du temps, d’autres algorithmes de traitement des images numériques ont permis d’extraire de plus en plus d’informations du visage, et ce avec une plus grande précision. Grâce aux avancées dans le domaine du Deep Learning, nous pouvons former des modèles capables d’extraire et d’étudier des caractéristiques faciales plus avancées avec des résultats de détection plus précis et plus fiables qu’avec les techniques classiques de traitement des images numériques.

Figure 1. évolution de la détection des visages. Source : Ross.A. (2022)

Comment fonctionne-t-il ?

Le pipeline des systèmes de reconnaissance faciale varie quelque peu en fonction de la technologie, du cas d’utilisation et des algorithmes employés, mais suit globalement le schéma suivant:

Figure 2 : Pipeline de détection des visages. Source : Élaboration propre (2022)

Nous commençons par une image d’entrée qui est prétraitée avec des méthodes de normalisation, de correction gamma, de débruitage, entre autres. Cette étape nous permet de livrer l’image au système avec la meilleure qualité possible et le moins de variation possible. Certaines des techniques couramment utilisées sont:

- Égalisation de l’histogramme : utilisée pour augmenter le contraste global de l’image et répartir plus uniformément les valeurs des pixels.Ecualización del histograma: Se usa para aumentar el contraste general de la imagen y repartir los valores de pixeles de una forma más equitativa

Figure 3. égalisation d’une image. Source : SA. (2022)

- Correction de la luminosité : Plus l’image d’entrée est nette, concentrée, bien exposée et sans bruit.

Figure 4. Correction de la lumière. Source : SA (2022)

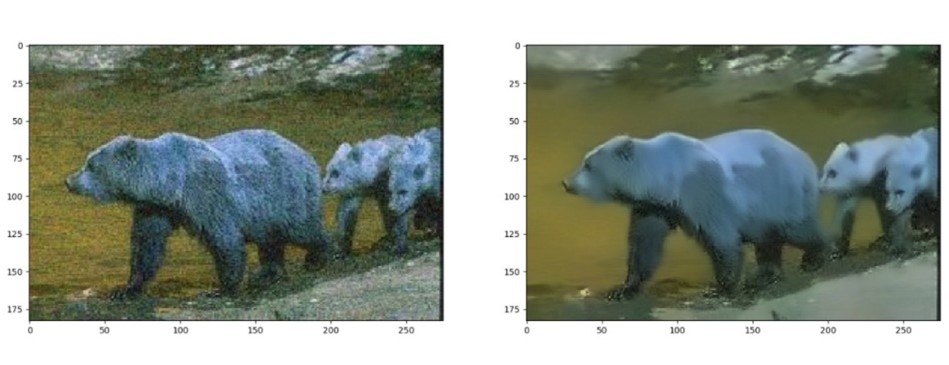

- Suppression du bruit : les filtres de traitement d’image numérique sont souvent utilisés pour lisser l’image et supprimer le bruit.

Figure 5 : Filtres de lissage. Source : SA (2022)

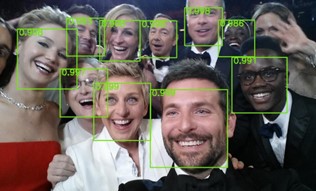

Vient ensuite le module de détection des visages qui localise la position des visages dans l’image. Aujourd’hui, on utilise souvent des modèles pré-entraînés, avec des ensembles de données comprenant un grand nombre d’images de visages, qui sont capables de localiser précisément et rapidement tous les visages d’une image, en renvoyant pour chacun d’eux une région de découpage contenant le visage détecté.

Figure 6 : Selfi aux Oscars 2014. Source : SA (2022)

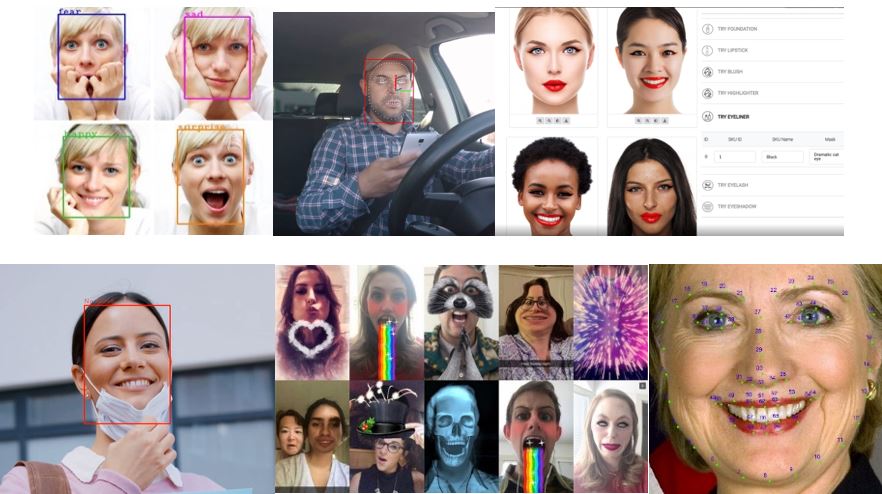

À partir de ce résultat, nous localisons les caractéristiques du visage lui-même, comme la position de la bouche, du nez, des yeux ou le contour du menton. Ces points sont appelés points de repère et permettent de résoudre de nombreuses applications telles que la détection du sourire d’une personne pour prendre automatiquement une photo, la reconnaissance des sentiments, la lecture sur les lèvres, l’application de filtres comme ceux de la célèbre application Snapchat, le contrôle de l’attention portée par un conducteur à la route, l’application de maquillage numérique et bien d’autres encore.

Figure 7. Exemples d’applications. Source : SA (2022)

Le module suivant sert à aligner les visages pour faciliter l’extraction des caractéristiques, puisque dans une image, on peut trouver les personnes qui y apparaissent en regardant dans les deux sens. Pour ce faire, nous utilisons généralement la référence des yeux et du menton ou du nez pour calculer la transformation qui laisse le visage bien aligné.

Figure 8 : Alignement des faces. Source : Élaboration propre (2022)

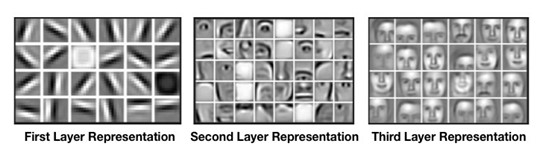

Enfin, on utilise couramment les réseaux neuronaux convolutifs, qui permettent de conserver les informations spatiales et sont très utiles pour l’extraction des caractéristiques faciales qui nous permettent de définir ce que l’on appelle l’empreinte faciale avec laquelle on peut vérifier ou identifier la personne.

Figura 9. Representación de mapas de características mediante el uso de redes neuronales convolucionales. Fuente: SA. (2022)

Ces deux tâches sont très différentes l’une de l’autre, la première est basée sur une formation unique d’un individu en prenant de multiples photos de son visage sous différents angles, de sorte que lors de la vérification, on peut utiliser des techniques telles que la distance cosinus, qui quantifie la distance vectorielle à un groupe d’images de l’individu, en évaluant s’il est celui qu’il prétend être ou s’il est quelqu’un d’autre. En revanche, si nous parlons de l’identification de la personne, il sera nécessaire de rechercher des correspondances dans une base de données avec des photos de l’individu afin de déterminer qui il est. Cette tâche est plus compliquée car nous pouvons trouver de nombreuses correspondances d’individus différents sur certains aspects ou caractéristiques et ce seront les scores globaux qui nous permettront d’obtenir un résultat final de coïncidence.

Figure 10 : Vérification vs. reconnaissance faciale. Source : SA (2022)

L’état de l’art

Grâce à l’explosion et aux progrès que nous connaissons dans le domaine de l’intelligence artificielle, nous pouvons trouver des exemples de code, de cadres, de bibliothèques et de documents qui traitent de la reconnaissance faciale et de nombreuses entreprises qui proposent des applications basées sur cette technologie. En fait, dans les services en nuage proposés par de grandes entreprises telles qu’Amazon, Microsoft ou Google, il est très courant de trouver des services d’identification et de reconnaissance faciale dans leurs offres.

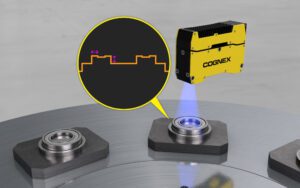

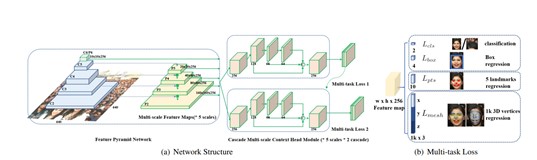

Les modèles de Deep Learning pour la détection et la reconnaissance des visages sont une combinaison de différentes architectures qui ont été développées pour d’autres usages mais qui sont tout aussi valables pour les visages. Le Retinaface en est un exemple. Ce réseau neuronal combine d’abord une extraction pyramidale de cartes de caractéristiques, à partir de laquelle 4 échelles différentes avec une profondeur de 256 cartes de caractéristiques chacune sont obtenues. Ensuite, une architecture multi-cascade est utilisée pour la localisation du visage et à partir de là, les réseaux neuronaux sont utilisés pour classifier, obtenir la boîte englobante du visage, obtenir les points de repère avec les points d’intérêt et enfin 1000 points pour créer le visage 3D.

Figure 11 : Vérification vs. reconnaissance faciale. Source : SA (2022)

Cas d’utilisation et controverse

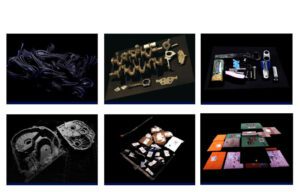

Avec les progrès de la technologie, nous pouvons trouver aujourd’hui une multitude d’applications où la reconnaissance faciale est utilisée. Identification des suspects et prévention des attaques terroristes, recherche de personnes disparues, vol à l’étalage, identification des utilisateurs dans le secteur bancaire, contrôle d’accès, reconnaissance de l’âge et du sexe des clients du commerce de détail afin de leur proposer la meilleure expérience ou les produits qui les intéressent, ADAS dans les véhicules autonomes, classification des images par personne ou groupe de personnes sur les smartphones, parmi beaucoup d’autres.

Les avis sont très partagés sur cette technologie, car beaucoup de personnes considèrent que la reconnaissance faciale viole la vie privée des individus. Certaines villes du monde travaillent avec des outils de détection et de reconnaissance faciale en temps réel, collectant des images de personnes pour générer de grandes bases de données de visages sans leur consentement.

D’autre part, de nombreux éléments indiquent que les algorithmes actuels de reconnaissance faciale produisent davantage de faux négatifs chez les personnes de couleur, allant même jusqu’à désigner cette technologie comme une technologie raciste.

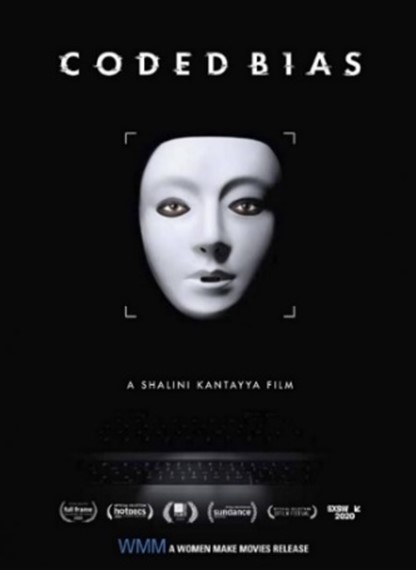

Le documentaire « Coded Bias », sorti en 2020, raconte l’histoire de Joy Buolamwini, chercheuse au MIT, qui a révélé que la reconnaissance faciale ne fonctionne pas correctement sur les peaux foncées. Elle s’est ensuite battue contre les autorités américaines pour modifier les algorithmes actuels afin d’éviter les préjugés raciaux.

Figure 12. Biais codé. Source : S.A. (2022)

Un autre point de discorde est qu’il a été démontré qu’il est actuellement assez facile de tromper les systèmes de reconnaissance faciale. Bien que les progrès actuels permettent aux systèmes de détecter les visages même lorsqu’ils portent un masque, il est possible de ne pas être détecté par ces systèmes grâce à certains développements d’anti-détection des visages qui utilisent des lunettes avec des lumières qui ne permettent pas d’extraire l’empreinte faciale de l’individu.

Figure 13. Lunettes anti-reconnaissance des visages. Source : S.A. (2022)

Conclusions

Malgré la grande évolution dans le domaine de la reconnaissance faciale, il reste beaucoup de travail à faire pour affirmer que cette technologie est fiable à cent pour cent, car la tâche de reconnaissance d’une personne est très complexe. Dans des domaines tels que la sécurité, la banque ou le commerce de détail, cette technologie marquera un nouveau mode d’accès à des lieux tels que les aéroports, les terrains de football, ou même les supermarchés, et la manière dont les utilisateurs sont contrôlés ou surveillés. Il est vrai que les résultats actuels sont prometteurs et que nous allons trouver de plus en plus de cette technologie dans notre vie quotidienne. En effet, dans le cadre du cheminement technologique vers l’automatisation des processus, la robotique et la numérisation, pouvoir s’assurer qu’une personne est bien celle qu’elle prétend être est un facteur très important si nous voulons être rassurés sur le fait de laisser les machines effectuer des tâches sans dépendre d’un contrôle humain constant.

Écrit par Sergio Redondo Cabanillas, R&D Manager chez Grupo Bcnvision.

Voulez-vous continuer à lire les blogs sur la vision industrielle ? cliquez ici

Vous souhaitez lire un autre article?

Vous avez un projet et vous voulez faire une demande de renseignements ? Contactez Bcnvision Morocco.